La Consultation populaire sur l’IA est lancée aujourd’hui, une initiative collaborative de la société civile créée en réponse à l’échec du gouvernement fédéral à fournir un processus de consultation significatif lors de l’élaboration d’une stratégie nationale d’IA en octobre 2025.

En 2025, le gouvernement a rapidement constitué un groupe de travail pour élaborer sa stratégie nationale sur l’IA. Elle était fortement orientée vers l’industrie, avec très peu de participants capables de s’exprimer sur les implications éthiques, sociales et politiques plus larges de la technologie.

Une consultation publique qui l’accompagnait n’a permis que 30 jours de rétroaction, empêchant les personnes les plus touchées par l’IA de participer efficacement. Les questions du sondage de consultation du gouvernement ont privilégié les bénéfices économiques au détriment des nombreux impacts négatifs de l’IA, et les réponses sont maintenant évaluées par l’IA plutôt que par les responsables publics.

Ces lacunes et d’autres ont été détaillées dans une lettre ouverte signée par plus de 160 organisations de la société civile et experts en octobre 2025, protestant contre le « sprint national » du gouvernement sur l’IA et documentant les nombreux impacts négatifs déjà en cours alors que les technologies d’IA s’implantent dans tous les aspects de la société canadienne.

La Consultation populaire sur l’IA offre une alternative significative. À partir d’aujourd’hui, les groupes d’intérêt public, les universitaires, les communautés touchées et les personnes à travers le Canada ont une occasion significative de s’exprimer sur la question de savoir si – et comment – l’IA devrait être adoptée et gouvernée au Canada.

Conçue pour une large participation, la Consultation populaire sur l’IA accueille tout, des résultats des discussions de quartier sur les impacts quotidiens de l’IA à des analyses approfondies d’experts. Le site web de la consultation fournit des ressources sur les implications actuelles de l’IA ainsi que des guides généraux et des outils de facilitation communautaire pour aider les gens à rédiger leurs soumissions de façon collaborative.

Les soumissions seront publiées sur le site de consultation, partagées avec le gouvernement fédéral et soutiendront les efforts de la société civile pour élaborer une réponse globale aux menaces posées par l’IA.

La Consultation populaire sur l’IA acceptera les soumissions jusqu’au 15 mars 2026.

Participez à la consultation ici :

anglais : https://www.peoplesaiconsultation.ca/

français : https://www.consultationpopulairesurlia.ca/

Citations sélectionnées :

Les citations représentent les points de vue des individus ou organisations cités

« Le gouvernement canadien pousse fortement l’IA comme un avantage pour notre économie. Elle cherche notre confiance, mais ne parvient pas à défendre les avantages de l’IA. Elle évite de s’attaquer aux nombreux pièges sérieux, surtout de l’IA générative, et ne fait que des efforts symboliques pour impliquer les Canadiens de manière large dans ce débat politique important. La Consultation populaire sur l’IA, en offrant aux Canadiens une base plus ouverte, inclusive et informée pour exprimer leurs opinions, offre une correction puissante. Le gouvernement devrait tenir compte des résultats à venir. »

– Andrew Clement, professeur émérite, Université de Toronto

« Les dommages collatéraux autour de la ruée ébriée à adopter l’IA se mesurent à des travailleurs licenciés, à des campagnes d’opérations psychologiques au service d’oligarques et autocrates corrompus, à des femmes et des minorités vulnérables intimidées au silence par des hordes de deepfakes, et par des suicides d’adolescents. Il est totalement inacceptable de permettre aux plateformes technologiques d’expérimenter sur des milliards de personnes à des fins privées sans aucune restriction significative. Nous avons un besoin urgent d’exigences obligatoires en matière de transparence, d’audits indépendants des plateformes d’IA, et de lois plus strictes sur la vie privée et la protection des consommateurs. »

– Ronald J. Deibert, OC, OO, professeur de science politique et directeur, CitizenLab, The Munk School, Université de Toronto

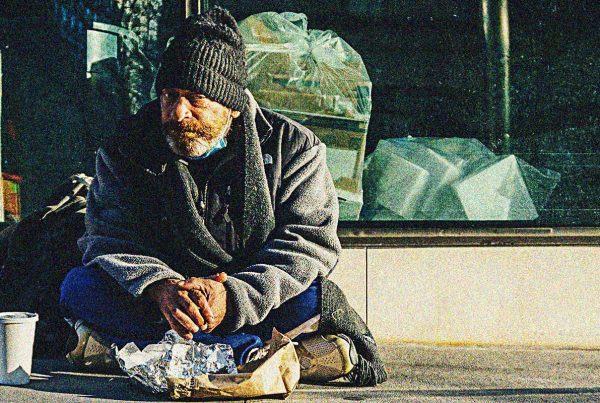

« La précipitation du gouvernement à automatiser les services avec une IA non réglementée pourrait renforcer les biais systémiques, nuisant de manière disproportionnée aux Canadiens vulnérables. Les réfugiés et les immigrants font face au risque le plus grave d’être laissés pour compte, potentiellement plongés dans une précarité plus profonde par des systèmes algorithmiques. »

– Debbie Douglas, directrice générale, OCASI – Conseil des agences de l’Ontario au service des immigrants

« Nous espérons que cet exercice de consultation permettra de montrer que l’innovation sociale en matière d’IA est aussi compatible avec des valeurs d’inclusion et de justice sociale. L’inclusion de la perspective des personnes citoyennes et plus largement celle de la société civile dans la gouvernance de l’IA est essentielle pour s’assurer que nous développions, au Canada, des systèmes d’IA qui répondent aux besoins de la population dans sa globalité et diversité. »

– Karine Gentelet, Professeure titulaire, Université du Québec en Outaouais et directrice scientifique Collaboration avec la société civile Obvia

« Le Canada ne peut pas revendiquer le leadership de l’IA tout en marginalisant les communautés déjà affectées. De la discrimination automatisée à la violence basée sur le genre facilitée par la technologie, l’IA amplifie les dommages structurels, et ceux qui sont les plus touchés doivent être au cœur de la construction de l’avenir de l’IA au Canada. »

– Meseret Haileyesus, PDG du Centre canadien pour l’autonomisation des femmes (CCFWE)

« Nous avons besoin que les travailleurs et le public aient un vrai mot à dire dans la définition d’une vision publique de l’IA au Canada. C’est la seule façon de s’assurer que l’IA sert les travailleurs et les gens ordinaires, pas seulement les grandes entreprises technologiques. Le CUPE appelle à des lois et règlements stricts pour protéger les travailleurs, le public et l’environnement. »

– Mark Hancock, président national du CUPE

« Dans sa course pour faire du Canada un chef de file de l’IA, notre gouvernement place les intérêts commerciaux avant de gérer son impact sur les droits humains, l’environnement et l’intégrité démocratique. Pourtant, les sondages d’opinion publique sont extrêmement clairs : les Canadiens exigent une stratégie d’IA qui s’attaque directement à ces impacts négatifs, et non une stratégie qui les traite comme une pensée secondaire. »

– Matt Hatfield, directeur exécutif, OpenMedia

« L’intelligence artificielle a eu des effets étendus sur la société et continuera d’en avoir pour un avenir prévisible. Il est impératif que nous atténuions les préjudices potentiels de l’IA sur le peuple canadien et ses institutions démocratiques. »

– Khasir Hean, co-organisateur, Technologues pour la démocratie

« L’IA est adoptée avec un inquiétant mépris pour les impacts négatifs qu’elle a sur nos vies – des impacts qui pesent surtout sur des groupes déjà précaires. Alors que l’IA transforme notre façon de travailler, d’apprendre, d’interagir entre nous et de nous surveiller par l’État, il est impératif que le Canada adopte une stratégie éclairée pour gérer cette technologie. »

– Tamir Israel, directeur, Programme de la vie privée, de la surveillance et de la technologie, Association canadienne des libertés civiles

« Les partisans des technologies nouvelles célèbrent la rapidité à adopter le changement sans se soucier des conséquences, mais c’est une approche catastrophique de la législation. Le gouvernement met en péril nos droits fondamentaux — y compris l’égalité et la vie privée, essentiels à une société libre et démocratique — lorsqu’il permet que le développement de la réglementation de l’IA soit précipité ou dominé par les intérêts de l’industrie. »

– Aislin Jackson, conseillère juridique du personnel politique, Association des libertés civiles de la Colombie-Britannique

« L’approche du gouvernement fédéral envers une « stratégie » nationale d’IA ressemble à une parodie du promoteur de l’IA, leur consultation prétendue n’étant qu’une mince façade pour fabriquer un consentement là où ils savent qu’il n’y en a pas. C’est une gifle à chaque communauté historiquement marginalisée et à chaque personne vulnérable qui a déjà été lésée par la négligence et l’arrogance de barons de la technologie voleurs qui privilégient les profits plutôt que les gens et l’ego plutôt que l’éthique. Si nous avons appris une chose à maintes reprises des conséquences en cascade et discriminatoires causées par tant de cycles de battage médiatique technologique — que ce soit le big data, les médias sociaux, la prise de décision algorithmique ou la genAI — c’est que ceux qui sont les plus touchés voient souvent l’avenir en premier, mais sont les derniers à être entendus. Cette initiative collective est une tentative d’éloigner le Canada de refaire cette grave erreur. »

– Cynthia Khoo, chercheuse principale, Citizen Lab; avocate en technologie et droits de la personne

« L’adoption irresponsable des systèmes d’IA mine déjà l’égalité substantielle dans notre vie quotidienne. Nous avons besoin de contrôles réglementaires qui mettent au centre les droits humains et l’égalité substantielle pour atténuer les profonds préjudices de cette technologie, mais le gouvernement élabore une stratégie nationale sur l’IA sans entendre ceux qui seront les plus touchés. »

– Rosel Kim, avocate principale, Women’s Legal Education and Action Fund (LEAF)

« La véritable menace existentielle de l’IA est pour la démocratie elle-même. Le gouvernement doit prendre au sérieux la participation publique à la gouvernance de l’IA, sinon il perdra complètement sa légitimité à gouverner. La volonté d’adopter l’IA avant tout risque d’ignorer les innombrables voix qui réclament une IA qui fonctionne pour les gens, pas pour le profit »

– Fenwick McKelvey, professeur agrégé, Université Concordia

« Les forces de l’ordre et les agences de sécurité s’appuient de plus en plus sur des outils d’IA pour renforcer la surveillance, dans le but d’évaluer les situations en temps réel et même de prétendre prédire les comportements futurs. Trop souvent, ces outils d’IA sont biaisés et leur adoption non réglementée continuera d’avoir des impacts dévastateurs sur les gens. Il est impératif que les communautés touchées par ces technologies aient l’occasion de se prononcer sur leurs impacts et les garanties possibles – et que le gouvernement canadien écoute ce qu’ils ont à dire. »

– Tim McSorley, coordonnateur national, Groupe international de surveillance des libertés civiles

« Adopter le battage médiatique de l’IA ne nous aidera pas à bâtir un avenir meilleur. Nous pouvons bâtir une voie meilleure et unique au Canada en prenant au sérieux les préoccupations très réelles de tous au Canada concernant l’IA, en nous engageant dans des consultations significatives, en assurant des droits de refus et en développant des protections solides et exécutoires qui privilégient le bien-être des gens et de l’environnement au détriment des intérêts des grandes entreprises technologiques qui causent tant de tort. »

– Joanna Redden, codirectrice du Starling Centre

« Consulter la population quant aux enjeux de l’automatisation et du déploiement de l’intelligence artificielle ne que difficilement être traité automatiquement à l’aide d’outils d’IA. La démarche actuelle du gouvernement souffre d’un important déficit de légitimité. Il est temps que la société civile se prenne en main et se fasse entendre. »

– Jonathan Roberge, Professeur-chercheur titulaire, Chaire de recherche du Québec sur l’intelligence artificielle et le numérique francophones (IANF), IRNS

« L’apprentissage, le développement et la croissance des étudiants sont dictés par une poignée d’entreprises technologiques obsédées par les tendances et axées sur le profit, dont l’intérêt est leur rentabilité plutôt que le bien-être des étudiants. Les preuves croissantes des impacts négatifs de l’IA générative sur les compétences de pensée critique des étudiants ainsi que sur leur bien-être social, culturel et psychologique devraient éveiller de grandes alarmes contre cette intégration non critique et non consensuelle. Pendant ce temps, le gouvernement investit dans l’IA générative qui sape la main-d’œuvre et les conditions de travail des éducateurs, gaspillant des ressources mieux utilisées pour résoudre de vrais enjeux en éducation. La Consultation populaire sur l’IA est une étape essentielle pour contrer et assurer que l’avenir des centres d’éducation canadiens réponde aux vrais besoins des éducateurs et des élèves. »

– sava saheli singh, professeure adjointe de futurs numériques en éducation, Université York

« La politique de l’IA ne peut pas être laissée aux industries qui en profitent. BC Policy Solutions appuie la Consultation populaire parce que nous avons besoin d’un cadre de gouvernance de l’IA fondé sur la justice économique — un cadre qui protège les travailleurs et l’environnement, récupère l’infrastructure de données publiques et garantit que l’IA répond aux besoins sociaux collectifs plutôt qu’à un simple oligopole privé. »

– Véronique Sioufi, chercheuse en équité raciale, BC Policy Solutions

« Les préoccupations exprimées par la société civile et par les groupes les plus touchés par l’IA, au Canada comme ailleurs, doivent être entendues par le gouvernement et faire l’objet d’une prise en considération sérieuse. Toute l’infrastructure qui sous-tend l’IA au Canada, dans le cadre du virage vers la souveraineté numérique (données, centres de données, etc.), a des implications éthiques, budgétaires, sociales et environnementales qui doivent être débattues en société. Dans un contexte d’urgence climatique, l’IA se caractérise par un impact environnemental considérable, reposant sur une extraction massive de ressources minérales ainsi que sur une consommation importante d’eau et d’électricité pour faire fonctionner les centres de données. L’IA canadienne ne peut prétendre à la souveraineté sans la participation et l’implication démocratique de sa société civile dans les décisions qui la concernent, ni sans la possibilité pour celle-ci d’exprimer un refus. »

– Sophie Toupin, professeure adjointe, Université Laval

À propos de l’Association canadienne des libertés civiles

La CCLA est une organisation indépendante à but non lucratif avec des partisans de partout au pays. Fondée en 1964, la CCLA est une organisation nationale de défense des droits humains engagée à défendre les droits, la dignité, la sécurité et les libertés de toutes les personnes au Canada.

Pour les médias

Pour plus de commentaires, veuillez nous contacter à media@ccla.org.

Pour des mises à jour en direct

Veuillez continuer à consulter cette page et nos plateformes de médias sociaux. Nous sommes sur Instagram, Facebook, Twitter et Blue Sky.