10 juin 2021

Aujourd’hui, le commissaire à la protection de la vie privée du Canada a publié le Rapport spécial au Parlement sur l’utilisation de la technologie de reconnaissance faciale par la police au Canada, concluant que l’organisme national de police du Canada, la GRC, n’était pas en conformité avec la Loi sur la protection de la vie privée lorsqu’elle a acquis et utilisé la technologie de reconnaissance faciale Clearview IA. La GRC conteste qu’ils ont violé la Loi, apparemment en considérant qu’il serait déraisonnable pour eux d’évaluer la conformité des fournisseurs aux lois canadiennes et que l’article 4 de la Loi sur la protection de la vie privée ne les oblige pas techniquement à le faire.

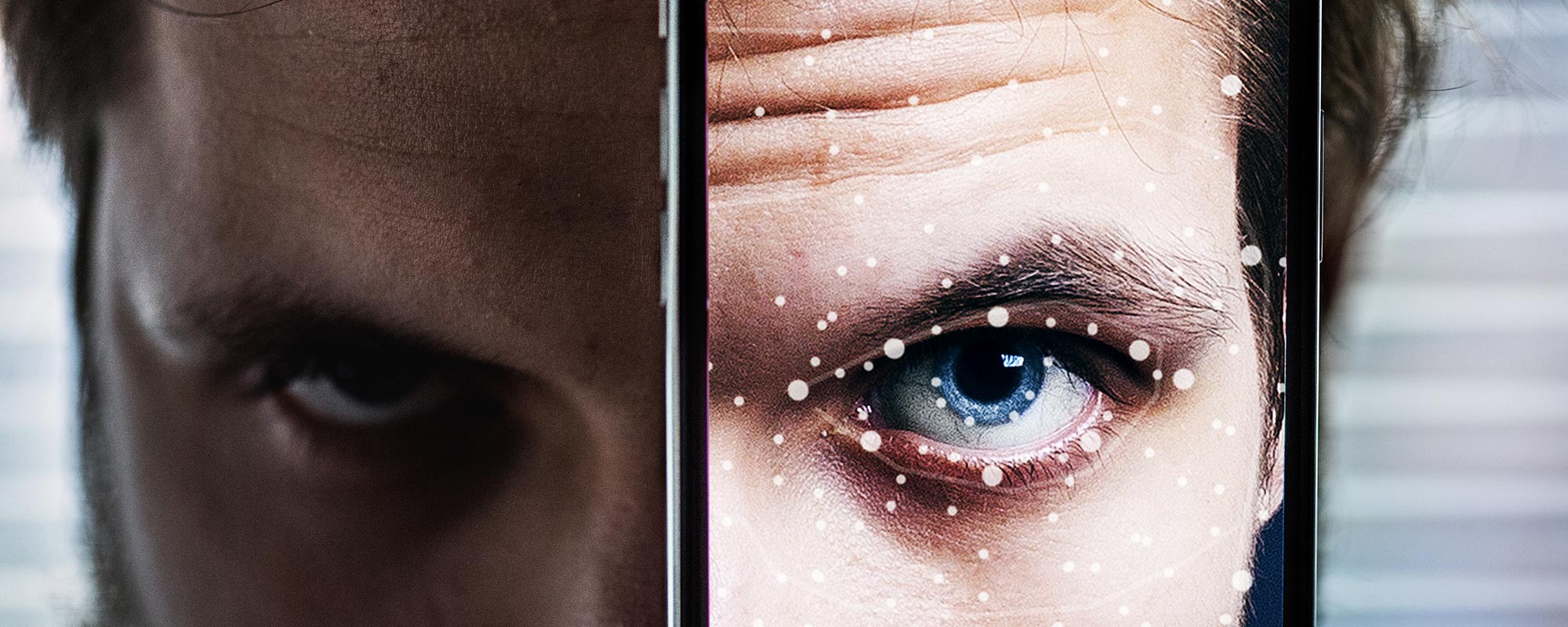

Clearview AI est un fournisseur américain de reconnaissance faciale qui est devenu largement connu en janvier 2020, lorsqu’une enquête du New York Times a révélé que l’entreprise avait extrait 3 milliards de photos de personnes sur Internet, créé un système de reconnaissance faciale pour exploiter cette base de données, et commercialisait l’accès aux forces policières à l’échelle mondiale.

Il s’agit de la deuxième enquête concernant Clearview AI menée par le Bureau du commissaire à la vie privée. Dans la première, en vertu de la loi canadienne sur la vie privée du secteur privé, connue sous le nom de PIPEDA, le rapport d’enquête cinglant indiquait que Clearview utilisait des milliards d’images de personnes à des fins inappropriées : « la collecte massive d’images… représente l’identification et la surveillance massives d’individus par une entité privée dans le cadre d’une activité commerciale » à des fins « qui « seront souvent au détriment de la personne dont les images sont capturées » et « créeront un risque significatif de préjudice pour ces individus, dont la grande majorité n’a jamais été et ne sera jamais impliquée dans un crime. »

Compte tenu des conclusions directes d’illégalité dans l’enquête initiale en vertu de la PIPEDA, la CCLA attend de voir si cette enquête répondrait aux sérieuses questions soulevées par l’utilisation de cette technologie par la police, notamment la manière dont l’agence nationale de police du Canada a pris la décision d’utiliser cette technologie, et pourquoi aucune analyse interne n’a pas suscité de drapeau rouge concernant la conformité légale. Les conclusions de l’enquête d’aujourd’hui, publiées en vertu de la Loi fédérale sur la protection de la vie privée du secteur public, révèlent un schéma d’obscurcissement de la part de la GRC (par exemple, la GRC a déclaré avoir utilisé Clearview 78 fois, mais les dossiers de Clearview montrent que c’était 521) et de non-respect de procédures simples, comme une évaluation d’impact sur la vie privée demandée par l’OPC. Elles montrent en outre que la GRC redouble d’efforts sur une interprétation particulière de la loi (rédigée bien avant le développement de la TTR) pour tenter d’éviter d’agir de manière responsable, en tenant compte des droits à la vie privée des Canadiens lorsqu’on leur offre une technologie prometteuse pour leur travail, mais qui comporte des risques encore plus importants pour les Canadiens lorsqu’elle est utilisée. La GRC a finalement accepté de respecter les recommandations du commissaire, notamment en créant de meilleures évaluations de conformité juridique et en assurant une surveillance plus stricte lors de l’acquisition de nouvelles technologies basées sur les données.

Les habitants d’une démocratie ont besoin d’une protection contre la reconnaissance faciale sans entrave parce qu’elle représente une menace pour la liberté humaine, pure et simple. La reconnaissance faciale utilise les caractéristiques physiques de notre visage pour créer un modèle mathématique qui nous est unique, qui nous identifie, tout comme une empreinte digitale. C’est un identifiant inexcruciablement lié à notre corps, qui peut être recueilli à distance et sans notre connaissance ni notre consentement. Poussée à l’extrême, la reconnaissance faciale lâchée dans nos rues signifierait l’anéantissement de l’anonymat, une incapacité totale à se déplacer dans le monde et à être un visage dans la foule. Cela changerait fondamentalement la relation entre les résidents et la police, si la police avait le pouvoir d’identifier secrètement tout le monde, à volonté et sans restriction. Et bien sûr, compte tenu des défauts connus de la technologie, qui est moins précise pour les visages noirs que blancs, masculins ou féminins, d’âge moyen plutôt que jeunes, il y a d’énormes implications en matière d’égalité.

La police ne peut pas être au-dessus ou au-delà de la loi, et les interprétations internes, en coulisses, ne doivent pas guider l’acquisition de technologies de surveillance invasives, surtout compte tenu de l’absence de dispositions significatives de responsabilité ou de transparence en matière de surveillance policière.

Il y a un débat public qui doit désespérément avoir lieu autour des outils de surveillance de masse, sur les risques d’utiliser la collecte d’informations indiscriminées sur tout le monde pour attraper les rares méchants dans une mer de passants innocents vaquant à leurs occupations. Mais ce que l’histoire de Clearview AI, c’est qu’il y a un débat tout aussi urgent que nous devons avoir sur la responsabilité en matière de surveillance policière. Cependant, les questions fondamentales et nécessaires sur la nécessité, la proportionnalité et la légalité ne sont pas posées et répondues publiquement lorsque les technologies de surveillance policière sont acquises et utilisées en secret, comme ce fut le cas avec Clearview AI.

La police soutient souvent que cela compromet leur travail si les outils d’enquête qu’ils utilisent sont connus du public. Cependant, la licence sociale d’exercer les pouvoirs que nous accordons à nos forces de l’ordre ne peut exister que dans une relation de fiducie, et avant même d’en venir à la question de savoir s’il y a un avantage social à permettre à la police d’utiliser la technologie et, si oui, si elle l’emporte sur les risques sociaux, nous avons besoin d’une assurance que nos organismes d’application de la loi s’engagent à utiliser des outils conçus et mis en œuvre légalement. Cette enquête est un appel au changement. Les lignes directrices sur l’utilisation des FRT et la consultation prévues par l’OPC offriront une occasion essentielle pour les gens à travers le Canada d’entamer des discussions sur ce à quoi ce changement doit ressembler. La CCLA s’engage à contribuer à ce changement.

À propos de l’Association canadienne des libertés civiles

La CCLA est une organisation indépendante à but non lucratif avec des partisans de partout au pays. Fondée en 1964, la CCLA est une organisation nationale de défense des droits humains engagée à défendre les droits, la dignité, la sécurité et les libertés de toutes les personnes au Canada.

Pour les médias

Pour plus de commentaires, veuillez nous contacter à media@ccla.org.

Pour des mises à jour en direct

Veuillez continuer à consulter cette page et nos plateformes de médias sociaux. Nous sommes sur Instagram, Facebook, Twitter et Blue Sky.